Séance des collaborateurs de l’Association canadienne de santé publique : Explorer l’éthique de l’IA en santé publique

Contexte (but et objectifs)

Le 29 mai 2018, à Montréal, l’Institut de la santé publique et des populations des Instituts de recherche en santé du Canada (ISPP des IRSC) a été l’hôte d’une séance à Santé publique 2018, en collaboration avec l’Institut canadien de recherches avancées (ICRA), qui visait à discuter des défis éthiques liés à l’intégration d’approches reposant sur l’intelligence artificielle (IA) dans la recherche et la pratique en santé publique.

Les objectifs de cette séance étaient les suivants :

- Accroître la sensibilisation aux défis éthiques en matière de santé publique que posent les approches reposant sur l’IA

- Développer une meilleure compréhension des répercussions potentielles de l’IA sur l’équité en santé

- Déterminer les rôles potentiels des praticiens de la santé publique, des responsables des politiques, des éthiciens, des chercheurs et des intervenants du secteur privé (innovation) pour relever les défis éthiques que pose l’IA

Les experts invités à diriger la discussion étaient les suivants :

- Dr David Buckeridge – professeur d’épidémiologie et de biostatistique, Université McGill (recherche en santé publique)

- Mme Erin Kelly – chef de la direction, Advanced Symbolics (secteur privé/innovation)

- Dre Joëlle Pineau – professeure, École d’informatique, Université McGill; boursière principale, programme d’apprentissage automatique et d’apprentissage biologique de l’ICRA (recherche sur l’intelligence artificielle)

- Dr Denis A. Roy – vice-président, Science et Gouvernance clinique, Institut national d’excellence en santé et en services sociaux (politiques/mise en œuvre)

- Dr Bryn Williams-Jones – professeur et directeur de la bioéthique, Université de Montréal (éthique)

Messages essentiels se dégageant des échanges

FAT/ML : La Dre Pineau souligne la valeur de l’apprentissage machine comme outil de transformation dans les domaines où il existe des données uniformes. Le défi consiste, selon elle, à utiliser la technologie de l’apprentissage machine pour analyser des données détaillées et hétérogènes, lesquelles sont souvent utilisées dans la recherche en santé publique.

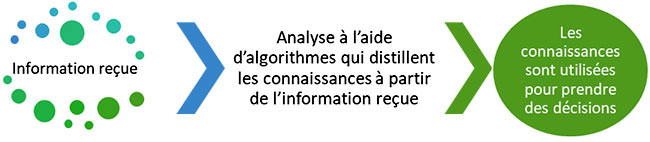

Figure 1 : Intelligence artificielle (IA), telle que définie par la Dre Joëlle Pineau

Description détaillée

Première étape: L’information est recueillie

Deuxième étape: L’information reçue est distillée à l’aide d’algorithmes

Troisième étape: Une décision est prise sur la base des connaissances acquises

En raison de la complexité des données de santé publique, les principales préoccupations éthiques en matière de santé publique peuvent être définies par le terme « FAT ML » (Fairness, Accountability and Transparency in Machine Learning), qui fait référence à l’équité, à la responsabilité et à la transparence en matière d’apprentissage machine (en anglais seulement), et qui est un concept fondamental des utilisations théoriques et appliquées de l’IA.

- Équité : Comment pouvons-nous garantir que les machines qui prennent des décisions sont impartiales et justes, en particulier pour ceux qui doivent vivre avec ces décisions? L’équité devrait être prise en compte dans la conception des algorithmes, la façon dont les données sont codées et le choix de ceux qui sont chargés de recueillir les données.

- Responsabilité : Comment ferons-nous pour attribuer la responsabilité dans les cas où les décisions ont été prises par des systèmes? La notion de responsabilité n’est pas la même pour les machines; est-elle suffisante dans le cas des systèmes?

- Transparence : Nous voulons un système qui puisse expliquer ses comportements, mais les machines sont moins bien équipées pour expliquer ces décisions.

Un débat honnête, critique et ouvert : Le Dr Bryn Williams-Jones fait porter la discussion sur l’éthique, en soulignant que le débat social et politique sur l’IA alimente des craintes relatives à la vie privée, à l’exclusion et aux désavantages potentiels pour certains groupes par rapport à d’autres. La science évolue lentement, et la façon dont nous vantons ses mérites, notamment les promesses potentielles de ses fruits, influe sur la politique publique. Comment concilier ces forces pour obtenir des résultats en tant qu’intervenants, compte tenu des structures sociales qui régissent la façon dont la science et l’élaboration des politiques se déroulent? Le Dr Williams‑Jones fait valoir que la meilleure façon de relever le défi lié aux promesses de la science lors de l’élaboration de politiques est d’avoir un débat honnête, ouvert et critique sur qui sont les parties socialement responsables en matière d’IA, ce dont ces parties sont responsables, et qui construit ces technologies. Le défi pour les responsables de la santé publique consiste à être transparents quant à ce que nous ne savons pas. La science est fondamentalement enracinée dans la société et, par conséquent, il est essentiel de faire participer à la fois les scientifiques et le public à des discussions honnêtes sur ce que nous savons et ne savons pas de l’IA en rapport avec la santé publique.

Coût de renonciation pour la santé publique : Le Dr Buckeridge souligne que la surveillance en santé publique a évolué, et que nous avons besoin de données et de méthodes d’analyse poussées pour explorer les cadres de causalité qui déterminent les conditions de santé et les inégalités que nous constatons dans la société, comme la santé publique de précision qui évalue les avantages sociaux et les risques individuels. En santé publique, on n’utilise pas tellement les nouvelles technologies pour analyser des données détaillées, sur le plan individuel, afin de comprendre les facteurs déterminants des conditions de santé publique et la façon de réagir efficacement à ces enjeux. Le scientifique laisse entendre que ce cette faible utilisation des technologies pourrait être attribué à une insuffisance de ressources, de formation et de capacité requises pour soutenir la compréhension des données et des analyses résultant de l’utilisation d’outils d’IA. Il y a un coût de renonciation évident que la santé publique assume en ne mettant pas les données à la disposition des organismes de santé publique pour qu’ils les analysent à l’aide d’outils d’IA, ce qui pourrait mener à un déséquilibre dans la compréhension des avantages de ces outils pour la société.

Transparence des méthodologies reposant sur l’IA : Mme Kelly souligne qu’avec des ensembles de données plus vastes, il serait possible de recueillir des données qui soient plus représentatives des populations de partout au Canada. Pour relever des défis complexes comme la prévention du suicide et la lutte à la crise des opioïdes, qui touchent des populations souvent difficiles à atteindre, les technologies reposant sur l’IA et l’utilisation des médias sociaux peuvent faciliter l’accès à ces populations, si on les compare aux méthodes traditionnelles de santé publique.

Cependant, Mme Kelly fait valoir que les organisations qui utilisent ces technologies doivent être ouvertes à l’idée d’expliquer aux utilisateurs des connaissances la méthodologie qu’elles utilisent, et que les organisations de santé publique et les chercheurs qui travaillent avec des organisations industrielles doivent comprendre les méthodologies utilisées, à défaut de quoi, il sera difficile de s’assurer que celles-ci peuvent être reproduites dans d’autres contextes ou qu’elles sont véritablement représentatives. Il existe tant d’outils d’IA à utiliser, mais peu de méthodologies ouvertes et transparentes que les organisations sont prêtes à faire connaître. Les organisations et les chercheurs en santé publique qui utilisent ces outils d’IA et les clients finaux touchés par les résultats devraient être au courant des mécanismes et des algorithmes mis au point pour produire des connaissances, et devraient les exiger.

Valeur non réalisée, gouvernance collective et leadership communautaire : Le Dr Denis Roy souligne que la valeur non réalisée des données et de l’information dans la façon dont la santé publique fonctionne constitue un défi éthique qui mène à une utilisation inefficiente des ressources. Il qualifie d’omission la décision de ne pas réaliser la valeur des outils d’IA pour analyser les données de santé publique, car « nous ne faisons pas ce que nous devrions faire ». Le réexamen des règles éthiques liées à l’utilisation de l’IA dans la recherche sur les systèmes de santé permettra aux décideurs en santé publique de mieux utiliser les technologies reposant sur l’IA pour produire des données probantes à l’appui des politiques et de la mise en œuvre des systèmes de santé. Le Dr Roy soutient que nous avons besoin d’un leadership communautaire fort et d’une nouvelle gouvernance collective, dont la légitimité sera assurée si nous avons des citoyens et une capacité de leadership voués au bien commun en ce qui concerne la santé publique. La question des sources ouvertes est un secteur d’intérêt clé qui doit être protégé, mais accessible au public et transparent, afin que les populations puissent comprendre qui fait quoi avec leurs données, et comment celles-ci seront utilisées pour soutenir la santé et le bien-être de la population.

Résumé : Discussion dirigée entre le groupe d’experts et les participants à la séance

Les principaux points et suggestions suivants sont soulevés en réponse aux exposés de la Dre Joëlle Pineau, du Dr Bryn Williams-Jones, du Dr David Buckeridge, de Mme Erin Kelly et du Dr Denis Roy et aux discussions de groupe avec les participants en personne et sur Twitter, animées par le Dr Steven Hoffman.

Explicabilité : Il peut être difficile à ce stade d’obtenir des outils d’IA permettant d’expliquer pourquoi ils parviennent à leurs conclusions, mais en attendant, nous pouvons nous assurer que la méthodologie est transparente et examiner quels sont les ensembles de données d’essais utilisés pour créer ces outils.

Renforcement des capacités d’action : Nous devons repenser nos décisions pour améliorer l’éducation des acteurs en santé publique en ce qui a trait à l’utilisation de connaissances dérivées d’outils d’IA et à la prise des mesures qui en découlent. Nous pouvons le faire s’il existe des partenariats entre des scientifiques techniques, comme les informaticiens et les ingénieurs, et les personnes qui utilisent les décisions ou interprètent les connaissances produites à l’aide d’outils d’IA, comme les chercheurs, les praticiens et les éthiciens de la santé publique. Il faut poursuive la discussion afin de déterminer comment utiliser l’IA pour aider à agir dans le domaine de la santé publique.

Responsabilité et gouvernance : Un nouvel enjeu pour les décideurs en santé publique concerne le fait que de nouveaux renseignements continuent d’être produits, mais que nous ne tirons pas profit de la compréhension et de l’élaboration de mesures fondées sur ces renseignements. Il est important de remettre en question notre responsabilité du point de vue de la gouvernance du système de santé. Si les outils d’IA permettent de prédire avec plus de précision des situations touchant la santé publique comme les épidémies ou les effets de la légalisation du cannabis sur des communautés particulières, qui est responsable d’agir en fonction de cette information? Par conséquent, il est essentiel de considérer l’analyse prédictive utilisée par les outils d’IA comme une nouvelle dimension de la pratique et de la prise de décisions en santé publique.

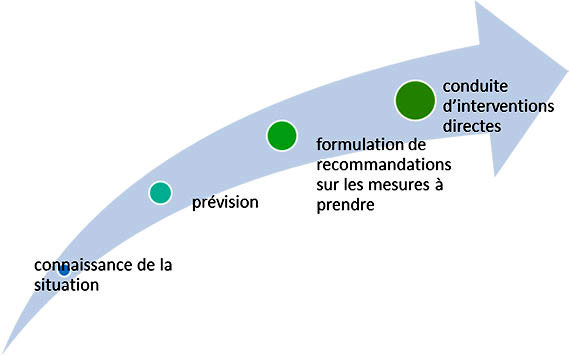

Niveaux d’autonomie des systèmes d’IA en santé publique : Il y a quatre niveaux qui soulignent l’augmentation de l’autonomie et la diminution de l’implication humaine en ce qui concerne les mesures prises par des systèmes d’IA, et dans le domaine de la santé, nous fonctionnons encore largement aux deux premiers niveaux (Figure 2) :

- Meilleure connaissance de la situation grâce à l’intelligence artificielle;

- Prévision;

- Les systèmes d’IA formulent des recommandations, au-delà des prévisions, sur les mesures à prendre;

- Les systèmes d’IA font des interventions directes.

Figure 2 : Les niveaux d’autonomie des systèmes d’IA, tels que définis par la Dre Joëlle Pineau

Description détaillée

- connaissance situationnelle

- prédiction

- fournir des recommandations sur les mesures à prendre

- mise en oeuvre d’interventions

Pour chacun de ces niveaux, il faudra examiner attentivement la façon dont l’application de l’IA peut influer sur les décisions et les résultats en matière de santé publique.

Préoccupations relatives à la protection de la vie privée et à l’échange de données : Un participant demande ce que les gouvernements peuvent faire pour garantir l’équilibre nécessaire entre l’utilisation d’outils d’IA en santé publique et la confidentialité des données, en soulignant les préoccupations du secteur de la santé en matière de confidentialité et d’échange de données, et la question actuelle à savoir ce qui doit primer, l’utilisation d’outils d’IA ou l’éthique les entourant. Les panélistes laissent entendre qu’il y a des secteurs et des organisations qui sont peu enclins à prendre des risques, mais qu’il y a des avantages et que le gouvernement est disposé à utiliser les outils d’IA pour régler des problèmes actuels de santé publique, comme la crise des opioïdes. La reformulation peut également servir de modèle; en demandant aux intervenants de reformuler la question, d’une approche protectionniste à une approche préventive, l’occasion se présente de définir des moyens communs de relever les défis actuels.

Principes de justice dans l’utilisation de l’IA : Un participant sur Twitter pose une question au sujet des principes de justice entourant l’utilisation de l’IA dans la surveillance et la collecte de données, ce qui incite le panel à demander aux participants de développer le concept de « justice »; cherchons-nous une justice sociale ou une justice distributive? La façon dont nous prenons des décisions en matière de santé publique dépend du type de justice que nous cherchons à obtenir.

Énoncé de position de la santé publique sur l’IA et les données massives : Les panélistes conviennent du fait que l’Association canadienne de santé publique et le secteur de la santé publique ont un rôle à jouer pour faire passer le message qu’il y a des coûts réels à ne pas mettre en commun les données qui pourraient sauver des vies. Les données sont un déterminant social de la santé, et c’est à la santé publique de déterminer comment elles peuvent être mieux utilisées. Parmi les exemples d’initiatives en cours, mentionnons #DataSavesLives (en anglais seulement) du Farr Institute et l’Open Data Movement. Toutefois, il peut être difficile de trouver un équilibre entre des données détaillées et complexes et le fait de pouvoir les analyser, et il est important d’énoncer les principes en vertu desquels les responsables en santé publique prennent des décisions ainsi que les risques potentiels pour la vie privée, afin de préserver le bien public. Il y a une responsabilité éthique de mettre en commun les méthodes afin que les données puissent être analysées simultanément dans tous les sites et dans la pratique de la santé publique, et la santé publique aurait avantage d’un point de vue stratégique à encourager la collaboration entre les milieux.

Mobiliser les champions de l’IA : Les panélistes laissent entendre qu’il serait avantageux d’intégrer des champions de l’IA dans les organismes de santé publique, car cela entraînerait plus de changements qu’une prise de décisions descendante. Les organismes de financement, comme les IRSC, jouent un rôle essentiel dans la coordination et le financement de pistes de discussion, de recherches et d’activités qui aideront à renforcer les capacités, à habiliter les chercheurs et les défenseurs à travailler dans cet espace, et à soutenir la croissance des réseaux.

Assurer l’équité : Les panélistes font valoir que l’équité commence au point d’origine des données, en commençant par la personne qui recueille les données. Il existe des moyens techniques d’intégrer des variables dans les algorithmes afin d’explorer les biais, ainsi que de construire et de former des algorithmes pour prédire un facteur particulier, mais il faut aussi tenir compte des types de données qui sont produites dans notre société et de la façon dont elles sont produites. Les panélistes insistent également sur le fait que nous devrions continuer à nous efforcer d’obtenir un échantillonnage représentatif des populations afin de nous assurer que nous travaillons activement à être inclusifs et à adopter des stratégies responsables pour échantillonner des populations traditionnellement « difficiles à atteindre ».

Sécurité d’emploi : Il est probable que nous assisterons à une énorme transformation des types d’emplois disponibles en raison de l’IA, qui sera davantage intégrée au marché du travail. Les panélistes notent que les chercheurs dans le domaine de l’IA n’ont pas aussi peur que l’IA élimine des emplois que ce que les gens entendent dans les médias, et citent l’exemple des avions équipés d’un pilote automatique, mais qui nécessitent toujours des pilotes pour des raisons de sécurité. Cependant, il existe de réelles préoccupations au sujet des autobus autonomes et d’autres technologies, et les panélistes laissent entendre que les emplois changeront, tout en exigeant un service à la clientèle et des mesures de sécurité qui nécessiteront de l’intelligence humaine.

Équilibrer l’utilisation de l’IA en santé publique : Un participant sur Twitter demande au panel comment la santé publique peut équilibrer son utilisation de l’IA dans un monde où il y a des acteurs utilisant l’IA qui ne partagent pas les mêmes valeurs qui guident la santé publique. Les panélistes invitent les participants à réfléchir à la façon dont la communauté de la santé publique échange avec les intervenants et les communautés dans d’autres secteurs, et indiquent que nous devrions faire part de nos principes fondamentaux à ces communautés. Le fait de demander davantage de transparence de la part de tous les intervenants pourrait être un gain net pour la santé publique, et la définition de ce qui constitue un risque tolérable et de la manière de l’évaluer en fonction des avantages pour le bien commun pourrait être une initiative constructive de santé publique et d’IA.

Réflexions finales

Le Dr Steven Hoffman résume les principales conclusions de la séance et invite les participants à poursuivre la discussion, notamment sur Twitter en utilisant le mot-clic #publichealthAI.

Voici quelques points à retenir de la discussion :

- Le dénominateur commun de la transparence et de l’explicabilité en ce qui concerne les données utilisées, les méthodes et l’application des résultats

- La santé publique est concernée par les considérations relatives au concept de FAT ML

- L’accessibilité des données et les problèmes de confidentialité sont des défis majeurs

- La responsabilité et la gouvernance ont été cernées comme des questions particulièrement pertinentes pour les systèmes de santé – à la fois pour savoir qui prend les décisions et qui doit répondre à ceux qui sont touchés par ces décisions Pour saisir cette occasion, nous devons faire preuve de leadership communautaire

- En ce qui concerne les niveaux d’autonomie, les systèmes d’IA en santé publique se situent actuellement entre la formulation de prévisions et la formulation de recommandations sur les mesures à prendre

- Une collaboration et un dialogue ouverts avec le public, ainsi qu’un recadrage de la conversation dans une optique de prévention, s’avèrent nécessaires

- Utiliser l’engagement collectif pour le bien commun comme moyen d’établir des liens avec d’autres secteurs

- Date de modification :